Rok 2026 ma szansę zapisać się w historii polskiego prawa jako moment uporządkowania zasad wykorzystywania sztucznej inteligencji. Przyjęcie przez Radę Ministrów 31 marca 2026 r. projektu ustawy o systemach sztucznej inteligencji to finalizowanie procesu, który na szczeblu unijnym rozpoczął się kilka lat wcześniej. Dla przedsiębiorców, prawników i programistów oznacza to przejście z fazy dobrowolnych kodeksów etycznych do etapu twardych rygorów prawnych i wysokich sankcji.

Ostatnie lata to niezwykle szybki rozwój algorytmów uczenia maszynowego i generatywnej sztucznej inteligencji. I ten rozwój przestał być domeną wyłącznie inżynierów, stając się sporym wyzwaniem dla legislatorów. Unia Europejska, jako pierwszy globalny gracz, wytyczyła szlak poprzez AI Act (Akt o AI). Dopełnieniem tych regulacji na gruncie krajowym będzie polska ustawa o sztucznej inteligencji, której projekt przyjęto 31 marca 2026 r. Ten duet legislacyjny będzie tworzył kompleksowe ramy prawne, które mają za zadanie pogodzić innowacyjność z bezpieczeństwem i prawami obywateli.

Źródło screena: https://www.gov.pl/web/premier/pierwsza-kompleksowa-regulacja-rynku-ai-w-polsce—nowe-decyzje-rzadu2

Akt o AI – Fundament europejskiego ładu cyfrowego

Rozporządzenie Parlamentu Europejskiego i Rady (UE) 2024/1689 z dnia 13 czerwca 2024 r., znane powszechnie jako Akt o AI (AI Act), to kamień milowy w regulacji systemów sztucznej inteligencji. Jego konstrukcja opiera się na tzw. podejściu opartym na ryzyku (risk-based approach). Podstawą Aktu o AI jest założenie, że regulacje powinny być proporcjonalne do zagrożenia. Ustawodawca unijny (a za nim polski projekt ustawy z 31 marca 2026 r.) wprowadził czystą hierarchię, która determinuje zakres obowiązków nakładanych na twórców i użytkowników technologii. Zamiast regulować samą technologię, Unia Europejska zdecydowała się regulować konkretne jej zastosowania, dzieląc je na cztery kategorie:

1 poziom: Niedopuszczalne ryzyko (Unacceptable Risk)

Systemy stanowiące wyraźne zagrożenie dla bezpieczeństwa i praw ludzi, które uznano za sprzeczne z wartościami Unii Europejskiej i zagrażające godności ludzkiej. Ich stosowanie na terenie RP i całej UE jest całkowicie zakazane od początku 2025 roku.

- Przykłady:

- Scoring społeczny (Social Scoring): Klasyfikacja osób fizycznych na podstawie ich zachowań społecznych lub cech osobowości przez rządy (podobnie jak w systemach kredytów społecznych).

- Manipulacja behawioralna: Systemy wykorzystujące techniki podprogowe, aby wpłynąć na decyzje człowieka w sposób dla niego szkodliwy.

- Zdalna identyfikacja biometryczna „na żywo”: Wykorzystywanie kamer do rozpoznawania twarzy w czasie rzeczywistym w przestrzeni publicznej przez organy ścigania (z bardzo wąskimi wyjątkami dotyczącymi bezpieczeństwa narodowego).

2 poziom: Wysokie ryzyko (High Risk)

Są to systemy wykorzystywane w infrastrukturze krytycznej, edukacji, biznesie, rekrutacji czy sądownictwie. To najważniejsza kategoria dla sektora biznesowego i publicznego. Systemy te są dozwolone, ale muszą spełniać rygorystyczne wymogi w zakresie jakości danych, przejrzystości i nadzoru ludzkiego przed wprowadzeniem na rynek. Podlegają one surowym wymogom w zakresie jakości danych, dokumentacji technicznej i monitorowania.

Przykłady:

- Rekrutacja i kadry: Algorytmy oceniające CV, przeprowadzające analizę emocji kandydata podczas rozmowy kwalifikacyjnej lub decydujące o awansach.

- Infrastruktura krytyczna: AI zarządzające ruchem drogowym, dostawami energii lub wody.

- Edukacja i szkolenia: Systemy oceniające wyniki egzaminów lub decydujące o przyjęciu na studia.

- Medycyna: Robotyczne systemy chirurgiczne oraz oprogramowanie AI wspomagające diagnostykę nowotworową.

3 poziom: Ograniczone ryzyko (Limited Risk)

Dotyczy systemów takich jak chatboty. W tej kategorii głównym wymogiem jest obowiązek przejrzystości. Użytkownik końcowy musi mieć świadomość, że wchodzi w interakcję z maszyną (obowiązek przejrzystości/transparentności) i nie może zostać wprowadzony w błąd co do tego, czy ma do czynienia z człowiekiem, czy z maszyną.

Przykłady:

- Chatboty i asystenci wirtualni: Klient musi otrzymać jasną informację, że rozmawia z algorytmem.

- Deepfakes: Obrazy, nagrania audio i wideo wygenerowane przez AI, które przypominają istniejące osoby lub zdarzenia, muszą być wyraźnie oznaczone jako „wygenerowane przy pomocy sztucznej inteligencji”.

- Generatory treści: Systemy tworzące teksty o charakterze informacyjnym (np. wpisy na portalach informacyjnych) muszą ujawniać swoje pochodzenie.

4 poziom: Minimalne ryzyko (Minimal/No Risk)

Minimalne ryzyko: Większość obecnie stosowanych systemów AI (filtry spamu, gry wideo), które są wykorzystywane obecnie w codziennym życiu, mieści się w tej kategorii. Nie podlegają one dodatkowym restrykcjom prawnym wynikającym z Aktu o AI, choć ich twórców zachęca się do stosowania dobrowolnych kodeksów postępowania.

- Przykłady:

- Filtry antyspamowe: Algorytmy chroniące skrzynki pocztowe przed niechcianymi wiadomościami.

- Systemy rekomendacji: Algorytmy podpowiadające filmy na platformach streamingowych lub produkty w sklepach internetowych.

- Gry komputerowe: Mechanizmy sterujące zachowaniem postaci niezależnych (NPC).

Akt o AI wprowadza również rygorystyczne zasady dla modeli ogólnego przeznaczenia (GPAI), takich jak zaawansowane modele językowe, nakładając na ich twórców obowiązek ujawniania szczegółowych podsumowań treści wykorzystanych do trenowania algorytmów.

Dlaczego ta klasyfikacja jest tak ważna?

Polski projekt ustawy z 31 marca 2026 r. precyzuje, że błędna klasyfikacja systemu przez przedsiębiorcę może zostać uznana za próbę obejścia prawa. Jeśli firma wdroży system „wysokiego ryzyka”, traktując go jako „minimalny”, naraża się na kontrolę Komisji Rozwoju i Bezpieczeństwa Sztucznej Inteligencji Sztucznej Inteligencji i kary finansowe sięgające milionów euro. Zrozumienie tych poziomów jest zatem pierwszym i najważniejszym krokiem w procesie AI Compliance.

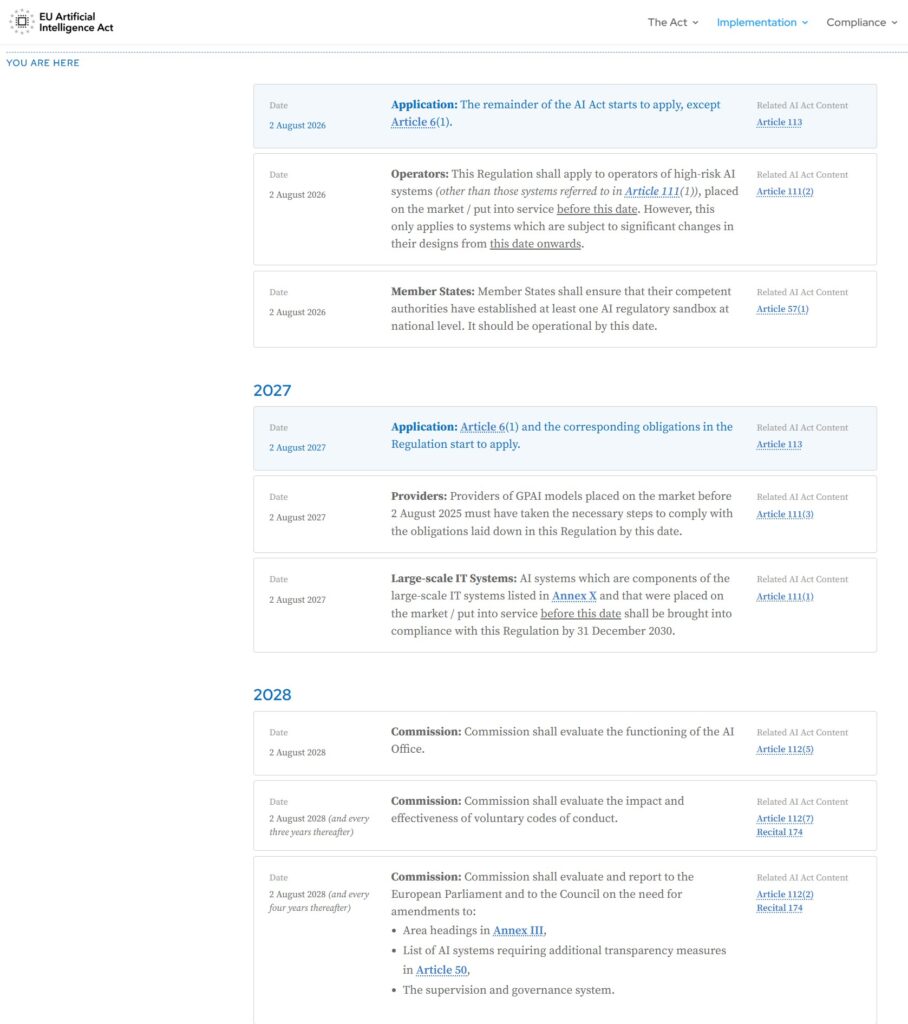

Harmonogram wdrażania Aktu o AI (Regulation 2024/1689)

Unijne rozporządzenie 2024/1689, czyli AI Act, weszło w życie 1 sierpnia 2024 r., jednak jego stosowanie zostało rozłożone w czasie, aby umożliwić rynkowi adaptację. Poniżej przedstawione są daty, które determinują dzisiejszy kształt rynku. Pełen harmonogram jest dostępny pod tym linkiem.

- 2 lutego 2025 r.: Wszedł w życie całkowity zakaz stosowania systemów AI o niedopuszczalnym ryzyku (m.in. rozpoznawanie emocji w miejscu pracy czy masowe scrapowanie wizerunków twarzy).

- 2 sierpnia 2025 r.: Zaczęły obowiązywać rygorystyczne zasady dotyczące modeli AI ogólnego przeznaczenia (GPAI) oraz wymogi w zakresie zarządzania danymi.

- 31 marca 2026 r.: Polska przyjmuje krajową ustawę implementującą, przygotowując grunt pod pełne stosowanie przepisów unijnych.

- 2 sierpnia 2026 r.: Data graniczna – od tego dnia większość przepisów Aktu o AI staje się w pełni egzekwowalna w całej Unii Europejskiej.

- 2 sierpnia 2027 r.: Termin objęcia regulacjami systemów AI wysokiego ryzyka, które są częścią produktów podlegających już wcześniej unijnym przepisom bezpieczeństwa (np. wyroby medyczne, lotnictwo).

Polska odpowiedź na AI Act: Projekt ustawy z dnia 31 marca 2026 r. o Sztucznej Inteligencji

Podczas, gdy Akt o AI określa ogólne zasady unijne, polski projekt ustawy z 31 marca 2026 r. stanowi niezbędne narzędzie implementacyjne, dostosowujące krajowy porządek prawny do wymogów UE. Jej przyjęcie jest odpowiedzią na potrzebę powołania organów nadzorczych oraz określenia ścieżek proceduralnych dla przedsiębiorców i instytucji publicznych.

Warto zwrócić uwagę na Art. 14 polskiego projektu ustawy, który nakłada na instytucje publiczne obowiązek prowadzenia rejestru systemów AI wykorzystywanych przy podejmowaniu decyzji administracyjnych. Jest to krok dalej niż wymogi unijne, mający na celu maksymalizację transparentności państwa względem obywatela.

Główne założenia polskiej regulacji:

- Powołanie Komisji Rozwoju i Bezpieczeństwa Sztucznej Inteligencji (KRiBSI): Jako centralny organ administracji, KRiBSI odpowiada za monitorowanie rynku, odbieranie skarg na działanie systemów AI, certyfikację systemów wysokiego ryzyka oraz nakładanie kar finansowych za nieprzestrzeganie przepisów.

- Piaskownice regulacyjne: Ustawa wprowadza mechanizm tzw. regulatory sandboxes. Pozwalają one polskim startupom i firmom technologicznym na testowanie innowacyjnych rozwiązań AI w kontrolowanym środowisku, pod okiem nadzoru, co minimalizuje ryzyko prawne na etapie wdrażania produktu.

- System kar i sankcji: Polski projekt ustawy precyzuje widełki finansowe za naruszenia. Zgodnie z unijnymi wytycznymi, kary mogą sięgać nawet 35 milionów euro lub 7% całkowitego rocznego światowego obrotu przedsiębiorstwa.

- Ochrona pracownika: Polskie przepisy kładą szczególny nacisk na przejrzystość algorytmów wykorzystywanych w procesach HR i monitorowaniu wydajności pracy, dając pracownikom prawo do wyjaśnienia decyzji podjętej przez system AI.

Co te zmiany oznaczają dla biznesu?

Dla sektora enterprise i MŚP, wejście w życie obu aktów prawnych oznacza konieczność przeprowadzenia audytu technologicznego. Firmy muszą zidentyfikować, czy stosowane przez nich narzędzia kwalifikują się jako systemy wysokiego ryzyka.

Wymagane będzie wdrożenie systemów zarządzania ryzykiem oraz zapewnienie odpowiedniej jakości zbiorów danych, aby uniknąć stronniczości (tzw. bias) algorytmów. Choć nowe obowiązki wiążą się z kosztami compliance, eksperci wskazują, że jasne ramy prawne budują zaufanie konsumentów, co w dłuższej perspektywie stymuluje wzrost rynku AI w Polsce.

Podsumowanie i perspektywy

Przyjęcie polskiego projektu ustawy o Sztucznej Inteligencji 31 marca 2026 r. to szansa za zakończenie działania niekontrolowanych algorytmów. Polska, łącząc europejskie standardy z krajową specyfiką, staje się dojrzałym rynkiem cyfrowym, gdzie innowacje mają służyć człowiekowi, a nie zagrażać jego autonomii. Wyzwaniem na najbliższe lata pozostanie sprawność operacyjna KRiBSI oraz zdolność polskich firm do adaptacji w nowym reżimie prawnym.

Źródła i dokumenty do pobrania

Poniżej znajdują się odnośniki do oficjalnych dokumentów, które stanowią podstawę prawną funkcjonowania systemów AI:

- Akt o AI (Rozporządzenie UE 2024/1689): Pobierz pełny tekst z EUR-Lex (PDF/HTML) Oficjalny tekst rozporządzenia w języku polskim, określający klasyfikację systemów i obowiązki dostawców.

- Implementation Timeline: Harmogram (ENG).

- Organy nadzoru rynku na podstawie aktu w sprawie sztucznej inteligencji: Link.

- Projekt ustawy o systemach sztucznej inteligencji: Opis.

- Projekt ustawy o systemach sztucznej inteligencji: Pobierz projekt wraz z dokumentami towarzyszącymi.

- U S T AWA o systemach sztucznej inteligencji: Projekt z dnia 10.02.2025 r.

- Wytyczne Komisji Europejskiej dotyczące godnej zaufania sztucznej inteligencji: Pobierz dokument (PDF) Zbiór zasad etycznych, które legły u podstaw europejskiej legislacji.